Virtual Production

Virtual Production

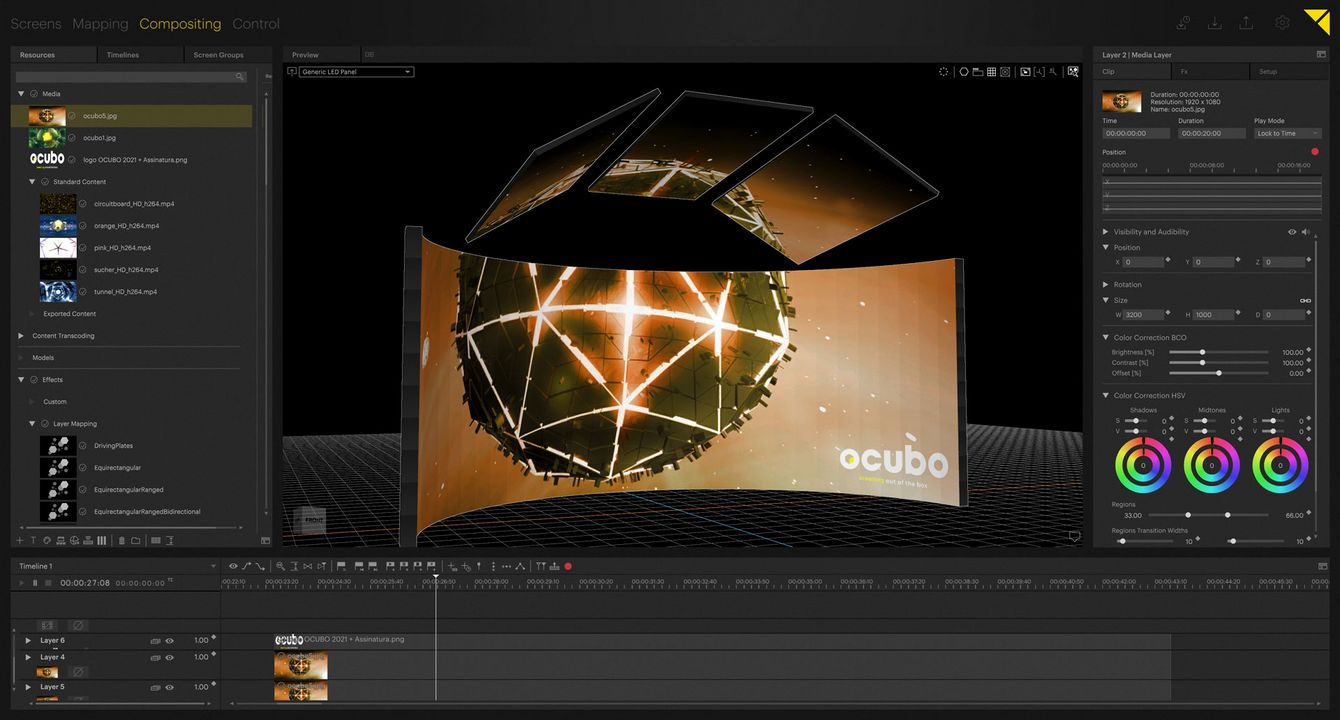

RESOURCE AS COMPOSITING

"Resource as Compositing" ist ein wichtiges Workflow-Feature, das es erlaubt, mit 3D-Welten aus anderen Anwendungen (Unreal, Notch) auf einfache und effektive Art in PIXERA zu arbeiten. Bereits seit der ersten Version von PIXERA haben Anwender die Möglichkeit, z.B. in die Leinwände "einzutauchen". Dort finden sie einen vollwertigen 3D-Compositing-Raum vor, in den nicht nur Videos, sondern auch texturierte 3D-Objekte geladen werden können.

Mit der neuen Version 1.8 werden Resources, die selbst eine 3D-Welt beinhalten, so integriert, dass ihr Compositing mit dem von PIXERA verschmilzt. Das Navigieren in der Preview, das Editieren von Perspektiven in die virtuelle Welt und vieles mehr erfolgt dann mit den gleichen Standardwerkzeugen, die auch sonst in PIXERA verwendet werden. Man kann sogar 3D-Objekte und Videos aus PIXERA in einem Compositing platzieren, das aus einer solchen Resource stammt. Die Handhabung von 3D-Szenen aus anderen Engines als Compositing legt damit die Grundlagen dafür, diese Resources einfach und extrem effektiv in PIXERA-Produktionen nutzen zu können.

Wovon sprechen wir, wenn wir Begriffe wie "Virtual Production", oder sogar noch spezifischer XR/AR/MR/VR verwenden?

Extended Reality (XR) ist ein populärer Oberbegriff, der zumeist alle in diesem Kontext gängigen Technologien (sowohl Software als auch Hardware) mit einschließt, die kombiniert oder erweitert werden können, um digitale Interaktionen mit der Wirklichkeit zu ermöglichen.

Abhängig davon, welchen konkreten Ansatz man in diesem Zusammenhang verfolgt, können auch die Begriffe Augmented Reality (AR), Virtual Reality (VR) oder Mixed Reality (MR) u. U. passender sein.

Weshalb sollte man sich mit Themen wie Virtual Production Setups, LED basiertes Studiodesign und Dingen wir XR Stages auseinandersetzen?

Obgleich es sicher stimmt, dass die Covid-19 Pandemie einer der Hauptgründe war, weshalb die Themen rund um virtuelle Produktionen, XR Stages und ähnliche Broadcast Setups so schnell so wichtig geworden sind, haben auch andere Faktoren zur Popularisierung beigetragen.

Der schnell voran schreitende technische Fortschritt der letzten Jahre im Bereich Echtzeitgrafik, extreme Hardwareleistung und die rapide angestiegenen Userzahlen bei 3D Software Engines sind ebenfalls wichtige Meilensteine, die zum Aufstieg und dem überaus großen Interesse an der Realisierung professioneller, virtueller Produktionen geführt haben.

Die Umsetzung eines voll immersiven Virtual Stage Setups ist zweifellos auch weiterhin ein Job für erfahrene Tech-Profis, gleichzeitig war es aber noch nie einfacher, inspirierende Live-Produktionsumgebungen für das jeweilige Zielpublikum zu kreieren.

Einige der Haupt-Featurehighlights der PIXERA Version 1.8 beziehen sich direkt auf Workflows für virtuelle Produktionen, wie z.B. die Unreal Engine Integration (s.u.).

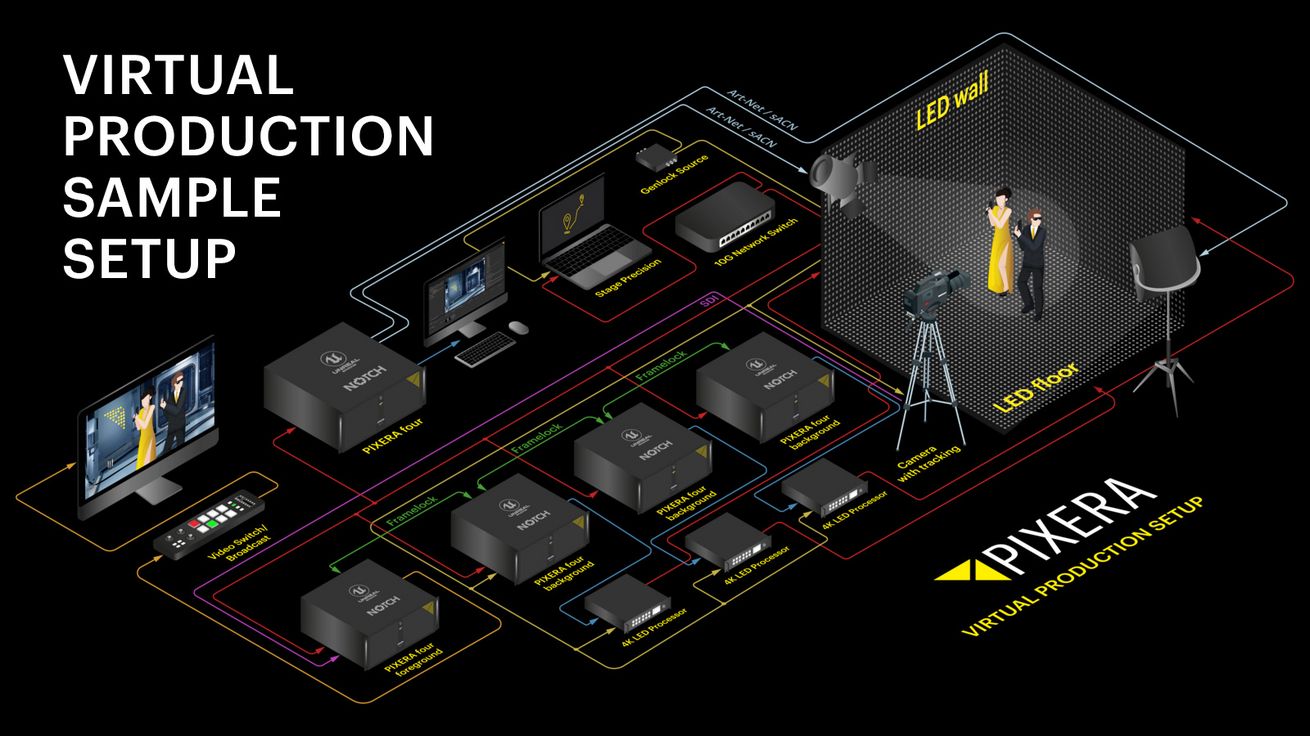

VIRTUAL PRODUCTION Sample SETUP (UNREAL)

- Ein PIXERA four director wird als Master für die Preview benötigt.

- Jede einzelne der LED Wände benötigt ihren eigenen PIXERA four für den Hintergrund und das rückprojizierte Kamerafrustum.

- UNREAL (plug-in) rendert auf dem PIXERA four als eine “resource-as-compositing” Integration.

- Es wird ein dedizierter PIXERA four Server mit einer Live-Capture Karte benötigt, um das Kamera-Livesignal und den Vordergrund zu mischen.

- Der Mischer-Output kann dann an den Videoswitcher gesendet werden.

- Stage Precision wird für die Bereitstellung von Trackingdaten (Mosys, Stype, Optitrack,...) über direct API an PIXERA verwendet.

- Genlock muss mit der Kamera, dem Trackingsystem, den LED-Prozessoren und einem der PIXERA Clients verbunden sein.

- Framelock muss verwendet werden, um die Client-Server zu synchen.

UNREAL CONTENT PLUG-IN

Durch das "Resource as Compositing"-Feature können Szenen aus der Unreal-Engine in PIXERA dargestellt werden. Ergänzend hat AV Stumpfl ein Plug-in für die beliebte Unreal-Engine entwickelt, das Eigenschaften einer Szene von PIXERA aus bearbeitbar macht. Das Plug-in kann beispielsweise in Unreal Objekte verschieben oder auf die Beleuchtung Einfluss nehmen.

In PIXERA selbst erscheinen die Eigenschaften aus der Szene als Teil des Layers, auf dem auch die Unreal-Resource liegt. Dadurch stehen die vertrauten PIXERA Timeline-Werkzeuge zur Verfügung, um die virtuelle Welt vielfältig zu gestalten. Im Ergebnis entsteht für den Anwender eine integrierte Editierumgebung, welche die technischen Besonderheiten in den Hintergrund treten lässt und dadurch die Konzentration auf das zu erreichende Show-Erlebnis erlaubt.

Unreal Integration

Der EPIC MegaGrant ist ein wichtiger Impulsgeber für unsere Arbeit an der Integration der Unreal Engine im Kontext virtueller Produktionen. Dieser Grant unterstützt konkret die Entwicklung der Low-Level Integration von Renderresultaten und soll PIXERA Usern die Möglichkeit eröffnen, Unreal Welten innerhalb von PIXERA's digitalen Produktionsworkflows optimal nutzen zu können.

Farbkorrektur

User können selbst entscheiden, wie und bis zu welcher Tiefe sie sich dem Thema Farbmanagement von PIXERAS Haupt-Navigationstabs aus nähern wollen.

Verschiedene Untermenus bieten eine Vielzahl an Optionen im Umgang mit PIXERAS internen Color Space-Einstellungen.

Ein Beispiel in diesem Zusammenhang ist die Unterstützung von OpenColorIO (OCIO), die es Usern ermöglicht, OCIO Konfigurationsdateien hochzuladen, welche dann PIXERAS Farbtransformationen bestimmen können.

Es ist auch möglich, ACES basierte Workflows mit PIXERA zu realisieren.

Ganz grundlegend können Farbänderungen auf den verfügbaren Timeline-Layern oder direkt an den Outputs mit Hilfe von einfach zugänglichen Menus und/oder mit einem traditionellen Colorpicker gemacht werden.

Die kreativeren Farbmanagementoptionen bieten z.B. die zusätzliche Möglichkeit, LUTs (Lookup Tables) den Ressourcen und Outputs zuzuweisen.

HDR-Einstellungen machen es möglich, HDR-Clipping und Kompensationswerte zu verändern.

Die Option, seine eigenen OpenGL-Shader schreiben und implementieren zu können, ist ein weiteres Highlight im Kontext der Farbmanagement- und Korrekturmöglichkeiten von PIXERA.

Downloads

Sollten Sie Wünsche, Fragen oder Anregungen zum Thema Virtual Production haben, können Sie uns gerne über folgende Mailadresse kontaktieren:

virtualproduction@PIXERA.one

Wir behalten uns das Recht vor, Änderungen im Interesse des technischen Fortschritts ohne weitere Ankündigung vorzunehmen.